百億級數據存儲架構設計 超越分庫分表的系統性解決方案

面對百億級數據的存儲挑戰,單純依賴分庫分表是遠遠不夠的。它只是解決海量數據存儲的基石之一,而一個健壯、可擴展的百億級數據存儲系統需要從數據模型設計、存儲架構、數據處理服務和運維保障等多個維度進行系統性設計。

一、 數據存儲層的核心設計

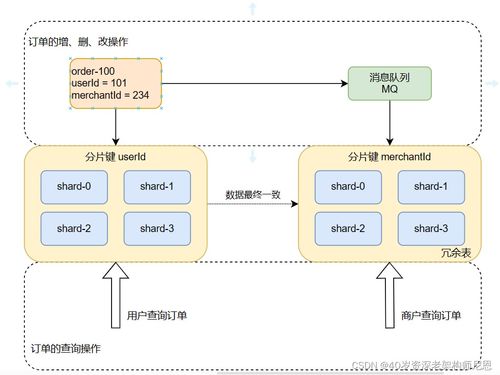

分庫分表(Sharding)確實是應對數據量膨脹的首要手段,但其設計遠非簡單拆分。

- 分片策略的精雕細琢:

- 分片鍵選擇:這是最關鍵的決定,直接影響數據分布的均勻性和查詢模式。需要根據核心業務查詢(如用戶ID、訂單ID、時間范圍)來選擇,并盡量避免跨分片查詢。對于時序數據,時間分區常與業務ID哈希結合使用。

- 分片算法:哈希取模能保證均勻,但擴容復雜;范圍分片易于擴容和管理,但可能產生熱點。實踐中常采用一致性哈希或其變種(如帶虛擬節點)來平衡分布與擴容的平滑性。

- 分片粒度:是分庫、分表,還是庫內分表?這需要權衡連接操作、分布式事務的復雜度與單點性能。

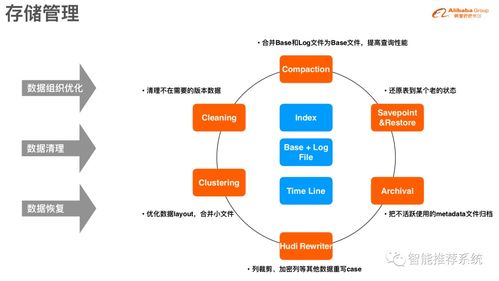

- 多級存儲與異構架構:

- 熱溫冷數據分層:百億數據中訪問頻率差異巨大。可以采用“在線數據庫(如MySQL/分布式NewSQL) + 分析型數據庫(如ClickHouse) + 對象存儲/歸檔存儲(如S3/HDFS)”的混合架構。熱數據保障低延遲讀寫,溫數據支持復雜分析,冷數據低成本歸檔。

- 索引與存儲分離:將主數據與索引分離存儲,例如使用Elasticsearch等專門檢索引擎處理復雜搜索查詢,源數據存儲在HBase或Cassandra中。

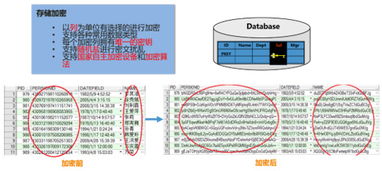

- 數據庫選型與優化:

- 根據一致性要求(CP/AP)選擇分布式數據庫,如TiDB(強一致)、Cassandra(最終一致)。

- 針對寫入密集型場景(如日志、監控),可選用LSM-Tree結構的存儲(如HBase, Cassandra),其順序寫入性能優異。

二、 數據處理服務的協同設計

存儲之上,必須有高效的數據處理服務來支撐業務。

- 數據寫入服務:

- 異步化與批處理:面對海量寫入,采用消息隊列(如Kafka, Pulsar)作為緩沖層,實現流量削峰和異步解耦。寫入服務從隊列消費后批量寫入存儲,大幅提升吞吐量。

- 冪等性與順序保證:在分布式環境下,通過唯一ID、版本號或事務性消息確保數據的準確性和一致性。

- 數據查詢服務:

- 查詢路由與聚合:需要中間件(或智能客戶端)根據分片鍵將查詢準確路由到對應分片。對于不可避免的跨分片查詢(如全量掃描、復雜聚合),設計并行查詢框架,在中間件層或使用MPP數據庫進行結果匯聚。

- 多級緩存策略:應用層緩存(如Redis集群)熱點數據,數據庫層緩存查詢結果。緩存更新策略(如旁路緩存、寫穿透)需精心設計以保持數據新鮮度。

- 讀寫分離與負載均衡:為讀多寫少的場景配置從庫,通過代理或客戶端實現讀寫分離,減輕主庫壓力。

- 數據處理流水線:

- 構建實時與離線兩套數據處理鏈路。實時流使用Flink/Spark Streaming進行實時統計、風控;離線數倉使用Hive/Spark進行T+1的深度分析與報表生成。

- 數據湖與數據倉庫:將原始數據以低成本格式(如Parquet)存入數據湖(如HDFS/S3),再按主題導入數倉,支持靈活的即席查詢與機器學習。

三、 保障體系的構建

- 可觀測性與監控:建立完善的指標監控(QPS、延遲、錯誤率)、鏈路追蹤和日志體系,快速定位瓶頸與故障。

- 彈性伸縮與自動化運維:存儲與計算資源應能根據負載自動伸縮。利用Kubernetes等容器編排技術管理無狀態服務,并實現分片遷移、集群擴縮容的自動化。

- 數據備份與容災:跨機房、跨地域的數據備份與容災方案必不可少。采用多副本機制保障高可用,定期全量備份加實時增量備份確保數據可恢復。

百億級數據存儲的設計是一個復雜的系統工程。分庫分表解決了數據分布的“分治”問題,但必須與精心的數據模型設計、異構的存儲選型、高效的數據處理服務層以及強大的運維保障體系緊密結合,才能構建出既穩定可靠又靈活高效的大數據存儲平臺。它考驗的是架構師對數據生命周期、業務訪問模式和技術棧特性的全局把握與深度整合能力。

如若轉載,請注明出處:http://m.mdj.org.cn/product/83.html

更新時間:2026-04-14 22:14:32