數據湖存儲格式Hudi 核心原理與實踐應用

隨著大數據時代的深入發展,企業對數據處理的實時性、一致性和管理效率提出了更高要求。傳統的數倉架構與原始數據湖方案在處理更新刪除、增量消費、實時分析等場景時面臨挑戰。Apache Hudi(Hadoop Upserts Deletes and Incrementals)應運而生,作為一種開源的數據湖存儲格式,它通過在HDFS或云存儲之上引入表、事務、高效索引等數據庫核心概念,為大數據處理與存儲服務帶來了革新。

一、Hudi的核心原理

Hudi的設計核心在于將存儲層(如HDFS)上的數據集組織成具有ACID事務支持的時間線(Timeline)管理的表,并提供了兩種基礎存儲類型:

- Copy-on-Write (COW) 表:

- 原理:在數據寫入時(無論是插入、更新還是刪除),Hudi會直接創建包含所有受影響記錄的新版本數據文件(Parquet格式),并同步更新元數據索引。查詢引擎始終讀取最新版本的文件。

- 特點:寫時合并,讀取性能高(直接讀最新文件),但寫入延遲較高且存在寫放大問題。適用于讀多寫少、對查詢延遲敏感的場景。

- Merge-on-Read (MOR) 表:

- 原理:將更新/刪除操作記錄到增量日志文件(Avro格式)中,并與基礎列式文件(Parquet格式)并存。在讀取時(或根據策略異步壓縮時),實時或異步地將增量日志與基礎文件合并,生成新的列式文件。

- 特點:讀時合并,寫入延遲低(只需寫增量日志),但讀取時需要合并,查詢延遲相對較高。適用于寫多讀少、對寫入延遲敏感且需要近實時分析的場景。

核心機制:

時間線 (Timeline):記錄所有對數據集的操作(提交、清理、壓縮等)及其狀態,是保證ACID語義和實現時間旅行查詢的基礎。

索引 (Index):Hudi提供了多種索引(如布隆過濾器索引、HBase索引等),用于快速定位一條記錄存在于哪個文件,從而實現高效的Upsert和Delete,避免全表掃描。

* 表類型 & 查詢類型:結合COW/MOR表類型與快照查詢(讀取最新合并數據)、增量查詢(讀取某個提交后新增的變更數據)、讀優化查詢(僅讀取MOR表的基礎列式文件)等多種查詢模式,為不同場景提供靈活的數據訪問視角。

二、Hudi在數據處理與存儲服務中的實踐

Hudi的價值在于它不僅僅是存儲格式,更是一套數據管理服務框架,能夠無縫集成Spark、Flink、Presto/Trino、Hive等主流計算查詢引擎。

1. 核心數據處理場景實踐:

高效的增量ETL管道:利用Hudi的增量查詢功能,可以輕松捕獲自上次處理以來的變更記錄,僅處理增量數據而非全量表,極大提升ETL效率,降低計算與IO成本。

近實時數據攝取與更新:通過Flink或Spark Streaming將Kafka等流式數據以Upsert方式寫入Hudi MOR表,可實現分鐘甚至秒級的延遲,并支持對歷史記錄的更新修正。

變更數據捕獲與同步:將數據庫的CDC數據直接寫入Hudi,構建一個支持更新刪除的實時數據湖鏡像,便于下游消費和分析。

數據回溯與時間旅行:基于時間線,可以輕松查詢數據在歷史任意時間點的快照狀態,滿足審計、故障排查、實驗回滾等需求。

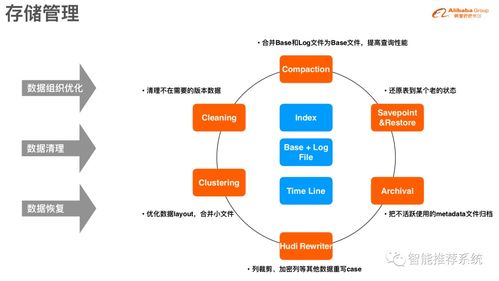

2. 數據存儲與管理優化實踐:

自動文件管理:Hudi自動處理小文件合并(壓縮),優化文件大小和數量,提升查詢性能。同時提供清理(Clean)功能,刪除不再需要的舊文件版本,控制存儲成本。

統一批流存儲層:Hudi表可以同時作為批處理和流處理作業的源與目標,實現了批流存儲的統一,簡化了Lambda架構的復雜性,助力向Kappa架構演進。

* 數據治理與合規:通過元數據管理、事務保障和數據生命周期策略(保留、清理),為數據湖提供更好的治理能力,滿足合規性要求。

三、最佳實踐與考量

在實踐中,成功部署Hudi需考慮以下幾點:

- 表類型選擇:根據讀寫模式(寫頻率、讀頻率、延遲要求)謹慎選擇COW或MOR。

- 索引選擇:根據數據規模和Upsert模式選擇合適索引,平衡寫入開銷與查詢性能。

- 資源配置與調優:合理設置壓縮(Compaction)、清理(Cleaning)策略的調度間隔和并行度,調整文件大小目標。

- 與現有生態集成:確保計算引擎(Spark/Flink版本)與Hudi版本的兼容性,并正確配置Catalog(如Hive Metastore)以支持多引擎查詢。

****

Apache Hudi通過將數據庫的事務、索引、高效更新等特性引入數據湖存儲層,有效解決了大數據場景下的增量處理、近實時更新和數據管理難題。它不僅是存儲格式的創新,更是構建高效、可靠、易管理的數據湖平臺的關鍵服務組件。隨著云原生和實時分析需求的增長,深入理解Hudi原理并善用其最佳實踐,將成為構建現代化數據處理與存儲服務體系的核心競爭力。

如若轉載,請注明出處:http://m.mdj.org.cn/product/84.html

更新時間:2026-04-14 18:52:39